作者:马赫环

如果说2025年是人形机器人的量产元年,2026年则会是量产PR版本的标准化之年。

标准化几乎是任何一个量产产品都需要解决的问题。人形机器人也不例外,工信部人形机器人与具身智能标准化技术委员会也于2025年底成立。

近日,工信部批准发布了《YD/T 6770—2026人工智能 关键基础技术 具身智能基准测试方法》,这成为具身智能领域首份行业标准,将于6月1日正式实施。该标准为具身智能领域构建了统一基准测试框架,规范了在仿真环境和真实环境下,开展具身智能基准测试的环境设置、任务库构建、测试过程和指标计算方法。

在具身智能领域,标准化的主要方向有两个:一个是硬件、核心零部件等方面的标准化;另一个则是针对数据采集、训练等层面的标准化。

硬件层面的标准化好解决,只要根据现行技术优势确立了技术参数和相关范围,标准化并不是什么大问题。2025年12月,工信部科技司宣布了人形机器人标准化技术委员会的成立,包括宇树科技、智元机器人等公司创始人在内,共有涵盖各赛道的65人组成。

另有报道显示,由乐聚机器人和东方精工联合打造的国内首条万台级人形机器人自动化产线近日在广东佛山正式启用。该产线年产能突破一万台,可实现每30分钟下线一台人形机器人。

只要具身智能企业能按目前的发展节奏不断提升量产能力,那么硬件层面的标准化均可以顺带实现。

多重数采方式并存 具身智能数据标准化无解?

具身智能真正发展起来时日尚短,因此在数据上的积累极为薄弱。

国际先进技术应用推进中心(深圳)2026年3月发布的《具身智能数据行业研究白皮书》(以下简称“白皮书”)提到,行业普遍认为,要实现具身智能的涌现至少需要百万小时来自真实世界的物理互动数据,目前积累的数量仅不到5%。

不同于互联网规模的文本与图像数据,具身大模型需要依赖收集特定机器人的操作数据,包括实际机器人本体的执行记录、模拟器生成的数据等,并且需要标注标签,这就令数据采集成本呈指数级上升。

加之具身智能系统的高度复杂性导致算法与硬件紧密耦合,异构数据难以互通,已成为具身智能发展的重要瓶颈。

所谓的异构数据,是由于机器人形态、采集方式、数据模态、坐标系等不同数据结构产生的数据类型,在具身智能赛道中大部分数据类型都为异构数据。

与异构数据类似的是同构数据。在实际使用中,同构数据可以无障碍使用在人形机器人的训练中,而异构数据则不能。

数量积累不足是一方面,同时由于多重数据采集方式并存,导致数据标准化几乎是个不可能解决的问题。

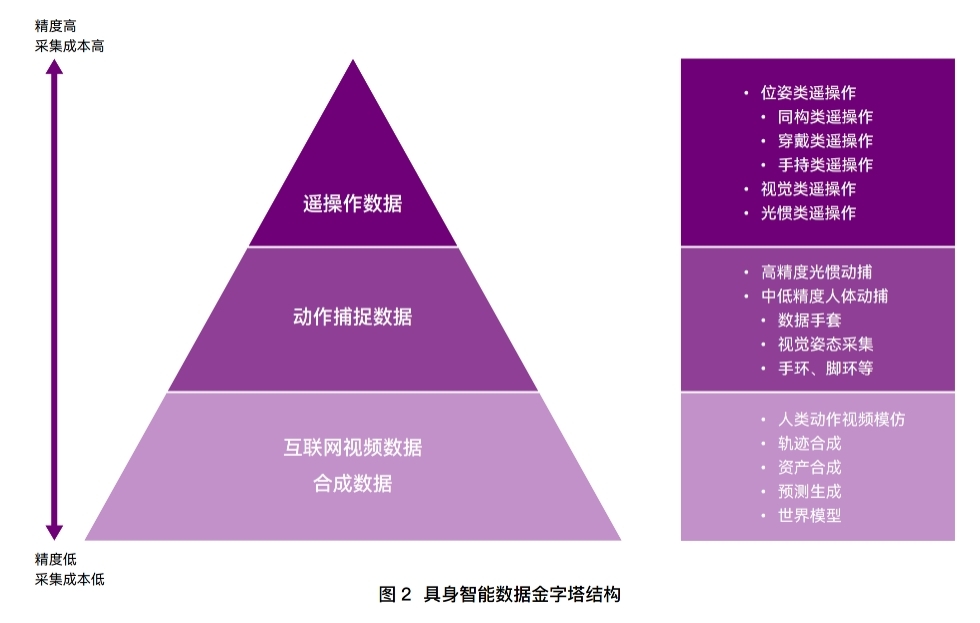

据白皮书介绍,目前具身智能数据采集主要有三种方式,分别为遥操作数据、动作捕捉数据及互联网视频数据。

遥操作数据能够获取高精度的多维度数据,但硬件成本和采集规模、速度上略显劣势;动捕数据兼具真实数据和合成数据的优点,正在补充操作和全身运动控制任务的数据需求;互联网视频数据和合成数据拥有巨大潜力,科研领域正在持续攻克应用难题。

每种数据采集方式在数据精度、规模化以及多样性方面各有千秋,无法统一数据采集的设备、格式或流程,所以异构数据几乎完全无法避免,目前业内主要针对数据采集后,如何用于测试提出场景与任务要求。

遥操作:高保真与高成本的两难抉择

据白皮书介绍,目前,遥操作类(Teleoperation)数据采集在当前发展阶段内占据主流地位。由于机器人本体发展还不成熟,在现实环境中让机器人自己收集数据存在非常大的障碍,而使用与实际应用的机器人完全相同的机器人进行数据收集,可以避免物理形态的差异,并实现高精度。

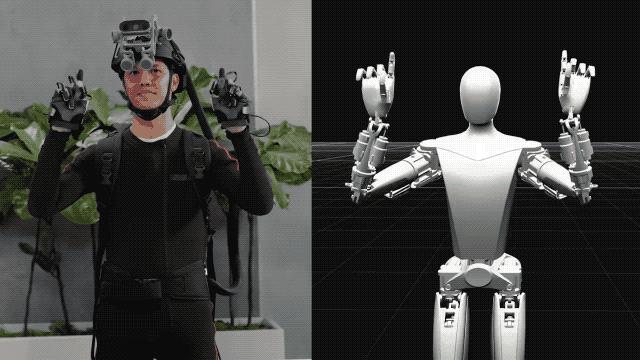

遥操作提供了一种最直接有效的人机协同控制方式,同时也是可靠的高质量交互数据来源,保证了数据的物理真实性——同步、完整地记录下整个操作过程中的所有物理状态变化,从而形成一条包含“动作意图-环境感知-物理执行”全链条高保真数据轨迹。

遥操作起步较早,国内企业也有多元布局,涉及视觉类、穿戴类、光惯类等细分操作方式。

如戴盟机器人推出的DM-EXton系列便携穿戴式遥操作数据采集系统,采用无线连接,支持54个自由度动作捕捉,采样频率达800Hz以上,可适配主流机器人平台。

松灵机器人推出PIKA轻量化小尺寸手持夹爪,重量仅550g,位姿精度最高达1.5mm。鹿明机器人推出FastUMI Pro数据采集系统,将单条数据采集时间从50秒缩短至10秒,效率提升5倍。

灵巧智能的DexCap数据采集系统,采用异构外骨骼架构,能实现毫米级动作捕捉与千赫级响应。灵心巧手推出的Open TeleDex模块化机器人遥操作系统,支持接入VR设备、可穿戴式外骨骼等其他控制终端进行主端输入,试图解决设备兼容性差的痛点。

因时机器人推出的外骨骼力控手套集成了5个直线伺服驱动器,支持14自由度动作捕捉。艾欧智能推出的全身动作捕捉解决方案中,包含高分辨率摄像头与深度传感器相结合的头盔,全身配备14个IMU(惯性)传感器,手套22个IMU传感器,提供全身动作与环境信息采集。

遥操作方案可采集到的数据类型多样,但短板同样突出,高成本则是其最大制约。数据采集设备叠加人力成本,有报道显示单小时数据采集成本可能突破万元。特斯拉2025年第二财季财报中整体营收同比下滑12%,净利润同比减少20.7%,遥操作数据采集的高投入被认为是拖累短期财务表现的重要因素。

动捕与视频学习:补充数据缺口却考较算法?

动作捕捉(Motion Capture)指的是将人的动作和姿态数字化的过程,只要能把人的动作姿态捕获下来、转化为数字序列,人体动捕示教数据和人类视频演示数据都可以被归纳为动作捕捉类型。

动作捕捉早期多应用于游戏和影视行业,随着具身智能赛道兴起,动捕技术开始应用于具身智能数据采集领域。

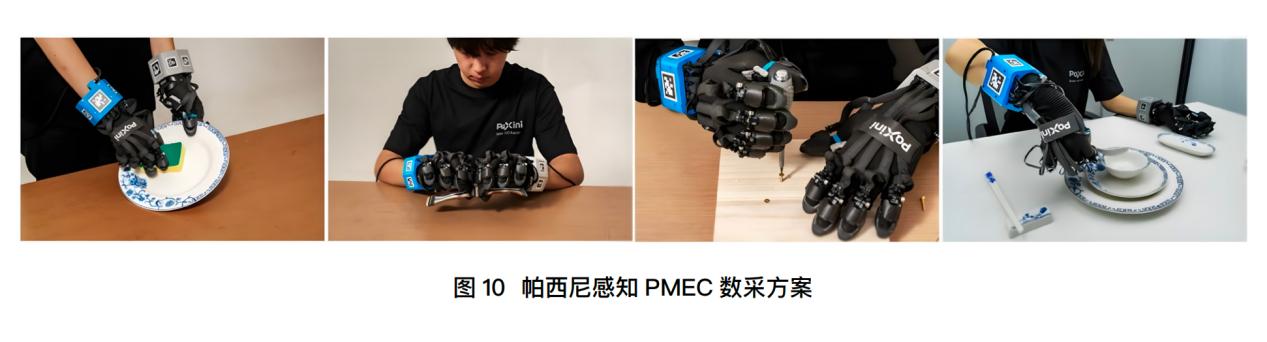

帕西尼感知在天津落地的1.2万平方米的具身智能超级数据工厂,内部部署了150个标准化采集单元,每天最多可采集55万条数据,预计每年生产近2亿条融合触觉、视觉、文本等多模态数据。

它石智航构建了一套模态齐全、可穿戴的具身数据采集系统,同时在灵巧手操作终端拥有TARS Dex灵巧手和TARS Dex视触觉夹爪,使算法能力能够更真实稳定地映射到物理世界。

诺亦腾的动捕系统通过生成数字人运动数据,为控制模型学习提供示教数据。相比传统的光学动捕系统,数字人运动数据成本更低,易普及,高精度、低延迟、抗磁干扰等特点,而备受重视。

不容忽视的是,动捕采集而来的数据但侧重于使用各种动捕设备(如数据手套、动作捕捉服等)记录操作员的动作,并为机器人作示教,而不是精确对应机器人运动,在采集的数据可用性上存在差异,比如针对不同型号机器人,需要对数据点进行重定位等操作。

而使用视频数据学习则是新兴的机器人学习方法,旨在利用人类视频演示作为来源,使机器人理解并模仿人类行为来完成复杂任务,无需手动编程而更经济,但对算法设计和训练的要求更高,目前提取的动作仍不精准,无法直接跨本体使用。

特斯拉已经开始使用视频学习方案,通过录制员工执行任务的视频,提取动作信息训练Optimus机器人。

字节跳动推出了GR-2(Generative Robot 2.0)机器人大模型,在预训练阶段观看了3800万个互联网视频片段,实现视频生成和预测,微调阶段使用了4万条机器人轨迹数据。

国内企业枢途科技也发布了自研SynaData数据管线算法,成本降至行业平均水平的千分之五,成本相较于遥操作降低200倍。

现阶段,正是由于多种数据采集方式的并行导致行业生态的多元化,硬件设施、算法模型上也是百花齐放,数据接口也谈不上标准化,因此导致大量异构数据出现,完全无法通用,因此在短期内几乎谈不上什么数据和训练的标准化和通用化。

解决方法虽然简单,比如建立统一采集范式和数据格式,推动企业间的数据共享,减少重复采集导致的异构问题,但涉及到不同企业之间的主导权以及利益,在执行中又面临多重博弈,或将是一场持续多年的硬仗。